AI Agent 会越来越像人吗?从 Tool、Skill、Memory 到 Soul 和 Rules

Posted on 日 05 4月 2026 in AI

| Abstract | AI Agent 会越来越像人吗?从 Tool、Skill、Memory 到 Soul 和 Rules |

|---|---|

| Authors | Walter Fan |

| Category | Journal |

| Version | v1.0 |

| Updated | 2026-04-05 |

| License | CC-BY-NC-ND 4.0 |

2026-04-05

这一两年,Agent 给人的感觉越来越像人了。

最早它只是会聊天,会思考,会推理。后来它有了工具,能查资料、改文件、跑命令。再后来它开始有 Skill,有 Memory,有 Soul,有 Rules。你越看越觉得不对劲:这玩意儿怎么像是在长器官?

刚开始它像个嘴很会说、手脚不太利索的实习生。再过一阵,它像个会用工具的同事。等它有了长期记忆、稳定人格和规则约束之后,你已经很难把它当成一个单纯的“聊天机器人”了。

一看到这儿,有人兴奋,有人害怕:它是不是快“变成人”了?是不是迟早替代咱们?

我的看法没那么戏剧化。Agent 的拟人化,本质上不是在复制人类的外表,而是在补齐人类工作的功能模块。 不是先长脸,而是先长脑、长手、长记忆、长习惯、长规矩,最后再长出“组织能力”。

这条路,其实已经挺清楚了。 去年初还是主要问 ChatGPT 问题,期待 AI 给的答案,现在已经让 AI 帮我做很多的案头工作了,写代码,改文档, 安排会议并写会议记录, 它越来越像一个聪明的秘书了, 幸亏我当年在国企干了两年秘书后果断转行了

先把一个误区打掉:拟人化,不等于真的“像人”

我们平时说“AI 越来越像人”,很容易脑补成两个方向:

- 它会像人一样说话、表达情绪、安慰你

- 它会像人一样工作、记事、协作、守规则

真正重要的是第二种。

前一种是界面层的拟态,后一种才是工程层的进化。企业愿意给 Agent 掏钱,可不是因为它会说“抱抱你”,而是因为它能:

- 读文档

- 调工具

- 记上下文

- 执行流程

- 遵守权限

- 在出错时回退

- 把任务交给别的 Agent

这些能力凑一块儿,才勉强接近“一个能上班的人”。

聊 Agent 的未来,别盯着它会不会变成电影里的机器人。盯着它有没有把知识工作里那些关键器官一个个长出来,更实在。

第一阶段:先有脑子,但还没有手

最早的大模型,其实更像一个高智商但坐在轮椅上的顾问。

它能思考,能归纳,能解释,能写一篇像模像样的文章,也能帮你分析代码和方案。但问题也很明显:它知道很多,却动不了环境。

这一阶段的能力核心是:

- 推理

- 语言生成

- 计划草拟

- 领域知识压缩

但它缺两样关键的东西:

- 感知外部世界的接口

- 改变外部世界的执行能力

所以那个阶段的大模型,看起来聪明,干活却总差点意思。就像办公室里有一种同事,脑子转得快,PPT 也写得漂亮,可你让他去系统里点一下、查个日志、改个配置,他两手一摊:“我没有权限。”

Agent 的第一步进化,就是给它装上眼睛、耳朵,然后是手。

第 1.5 阶段:有了多模态,Agent 才“睁眼看世界”

在装上手(Tool)之前,Agent 还需要先长出眼睛和耳朵。

最早的大模型只吃文本、只吐文本。你跟它聊天可以,但你发一张架构图给它,它看不懂;你给它一段会议录音,它听不见;你想让它帮你分析一段视频,它更是两眼一抹黑。

多模态(Multimodal)解决的就是这件事:让 Agent 的感官从纯文字扩展到图、声、视频。

别小看这一步。表面上是“多了几种输入格式”,实际改变远不止此。

输入侧:看得见、听得到

今天主流模型已经开始支持:

- 图片理解:看截图、看架构图、看白板手写、看 UI 界面、看报错信息截图

- 音频理解:听语音消息、听会议录音、做实时语音对话

- 视频理解:分析视频片段、理解屏幕录制、从监控画面中提取信息

- 文档理解:直接读 PDF、读扫描件、读表格图片

这意味着 Agent 的信息入口从“只能读文字”扩展到了“能看能听”。

举个实际例子。以前你想让 Agent 帮你排查一个前端 bug,你得把报错信息一行一行复制粘贴过去。现在你可以直接截个图扔给它,它自己看报错、看 UI 状态、看控制台输出,然后告诉你问题在哪。

再比如,你开完一个小时的会议,以前得自己写纪要。现在可以把录音扔给 Agent,它听完给你一份结构化的会议纪要,带 action items 和 owner。

现在我司的会议记录功能已经非常强了, 我当秘书时练就的会议速记本领几乎没啥用了,写得没 AI 快, 总结得没有 AI 全面, 唯有会议记录的 Action 那一项写得比 AI 强

这不是锦上添花。你想想,咱们日常工作中有多少信息是纯文本的?截图、录屏、白板、PDF、语音消息——到处都是非文字信息。

输出侧:不光会写,还会画、会说

多模态不只是输入端的事。输出端也在扩展:

- 生成图片:画流程图、生成 UI 原型、做数据可视化

- 生成语音:语音回复、语音播报、实时语音交互

- 生成视频:演示动画、教程视频(目前还在早期)

- 操作界面:直接在 GUI 上点击、拖拽、填表(Computer Use)

当 Agent 既能看截图又能操作界面时,很多需要人盯着屏幕点来点去的事情,就有了自动化的可能。

多模态对 Agent 架构的影响

多模态不只是“多了几个 API”,它会改变 Agent 的几个核心环节:

Context 变复杂了。 以前上下文里都是文本,token 好数。现在图片、音频、视频都进来了,上下文管理变成了多媒体资源管理。什么时候该把图片带上,什么时候只带文字描述,这是新的 context engineering 问题。

Memory 也要多模态化。 以前 Agent 记住的是文本事实。以后它可能还得记住“上次那张架构图长什么样”“用户上次发的那段语音里提到了什么”。记忆不再只是文字条目,而是多媒体索引。

Tool 调用会更丰富。 Agent 不再只是调 API,它可能需要先截个图、录个屏、拍张照,然后再决定下一步做什么。感知和执行开始交替进行,不再是“先想好再动手”。

Eval 更难了。 你怎么评估 Agent 看图的准确性?怎么评估它听会议录音的理解程度?文本有 benchmark,多模态的评估体系还远没有成熟。

所以多模态其实是一层基础设施。它让 Agent 从“只在文字世界活动”变成“在人类的真实工作环境里活动”。这一步之后,给它装 Tool 才更有意义——因为它不光有手了,还有眼睛。一个瞎着眼干活的人和一个看得见的人,效率差距不是一星半点。

第二阶段:有了 Tool,Agent 才真正“下地干活”

Tool 是 Agent 真正跨过“能说”到“能做”的分水岭。

一旦模型不再只是吐文本,而是能调用搜索、浏览器、shell、数据库、Git、邮件、日历、工单系统,它就不再是一个语言玩具,而是一个工作流节点。

今天大家常见的 Agent loop,基本都长这样:

读输入 -> 推理 -> 选择工具 -> 执行工具 -> 观察结果 -> 再推理 -> 继续执行

这条链子看着简单,变化却很大。模型不再只是“给建议”,而是自己去拿证据、跑命令、改状态、回填结果。

MCP 和 CLI 最近这么受关注,原因就在这儿。它不只是“多了一个工具标准”,而是把 Agent 的手脚从一个个私有插件,变成了相对统一的接口体系。

Tool 层后面还会往三个方向长:

1. 更标准

工具不再是随手写几个函数,而会逐步接近严格的 API contract:

- 输入有 schema

- 输出有固定 envelope

- 错误有统一格式

- 副作用有权限和预算

原因很简单:Agent 最怕的是“乱调工具”。参数错了、重复调用、重试失控、超时没兜住——这些比答错一句话致命得多。

2. 更安全

工具会进一步强调:

- 最小权限

- 沙箱执行

- 审批流

- 可回滚

- 审计日志

尤其是涉及付款、删库、发消息、合并代码、改生产配置这类动作,未来大概率不会允许模型想做就做,而是要经过 policy engine 或人工确认。

3. 更有身体感

今天的 Tool 更多还是数字世界里的手脚:文件、命令、网页、API。

再往后,它会进一步接入:

- 浏览器和桌面 UI

- 传感器

- 摄像头和语音

- 机器人和机械臂

- IoT 设备

一旦到了这一步,Agent 就不只是“有手”,而是开始有身体了。

第三阶段:有了 Skill,它才不像每次都从零上岗

只有 Tool 的 Agent,像一个什么都能碰一下、但做事全靠临场发挥的人。

Skill 要解决的是另一件事:怎么把反复出现的经验,沉淀成稳定套路。

你可以把 Tool 理解成工具箱,把 Skill 理解成套路。

- Tool 告诉 Agent:你手里有什么扳手

- Skill 告诉 Agent:碰到这个问题,按什么顺序拧

这跟人类工作中的 SOP 化一个道理。

一个新人入职,最开始也是会用系统,但不知道顺序。为什么老同事效率高?往往不是因为他每一步都更聪明,而是因为他已经知道:

- 先查哪里

- 再看什么

- 哪种情况直接跳过

- 哪种情况一定要升级处理

Skill 本质上就是把这些“工作套路”显性化。

Skill 层后面的趋势,我看主要有三个:

1. Skill 会越来越模块化

今天很多 Skill 还是长篇说明书。以后更像组件:

- 触发条件

- 输入要求

- 输出格式

- 执行步骤

- 失败处理

- 依赖工具

这让 Skill 不再是“给模型读的一段话”,而是一个能被组合、被继承、被测试的能力单元。

2. Skill 会越来越可蒸馏

前面那篇我刚写过,Skill 一长,token 就开始流血。

所以 Skill 后面会出现和代码重构很像的事情:

- 把冗长说明压缩成短版本

- 把例子抽成 references

- 把硬约束单独提出来

- 把常见套路沉淀成模板

这件事说小了是省 token,说大了是在做“经验压缩”。真正成熟的 Agent 生态,一定会出现大量 Skill marketplace、Skill optimizer、Skill testbench。

3. Skill 会越来越像“岗位能力包”

今天的 Skill 还偏任务导向,比如“写周报”“审代码”“查日志”。

再往后,Skill 会更像角色导向:

- Release manager skill set

- Security reviewer skill set

- Executive assistant skill set

- Customer success skill set

Agent 不只是学会一个动作,而是在装配一个岗位。

第四阶段:有了 Memory,它才不至于每次醒来都失忆

没有 Memory 的 Agent,像什么?

像一个每次开会都要重新自我介绍、重新问背景、重新看上下文的同事。再聪明也会把人烦死。

Memory 让 Agent 的行为开始跨回合、跨任务、跨时间连续起来。不只是记住几条事实那么简单。

现在比较成熟的方向,基本是分层记忆:

- Working memory:当前上下文窗口里的内容

- Summary memory:长对话压缩出来的摘要

- Long-term memory:用户偏好、项目背景、关键事实

- Artifact memory:文档、代码、文件、记录这些“外部记忆体”

后面这一层的重点不在“记更多”,而在怎么记、怎么忘、怎么共享。

1. 更会筛选

不是所有东西都值得记。真正难的是判断:

- 什么该记

- 记多久

- 记在哪一层

- 什么时候该忘

只会囤积记忆的 Agent,最后不会更聪明,只会更拧巴。

2. 更会共享

单 Agent 记忆还好办,多 Agent 场景就麻烦了。

未来很重要的一条线,是分层共享记忆:

- 全局共享

- 团队共享

- 角色共享

- 私有记忆

否则两个 Agent 不是互相失忆,就是互相串台。

3. 更可治理

有记忆就有风险,尤其是用户偏好、组织知识、操作历史这类数据。

后面 Memory 层一定会更强调:

- namespace 隔离

- tenant 隔离

- retention 策略

- 可删除

- 可审计

不然 Agent 越记越多,最后先出事的往往不是效果,而是合规。

第五阶段:有了 Soul,它才开始像“那个固定的它”

很多人对 Soul 这种文件名有点犯嘀咕,觉得太玄。

其实没那么玄。Soul 这层在技术上解决的是:同一个模型,为什么这次像你熟悉的助手,而不是另一个语气、另一个价值取向、另一套工作习惯的助手。

说白了,Soul 就是:

- persona

- tone

- preference

- decision bias

- stable style

你可以把它理解成一个长期稳定的“行为配置层”。

它的作用很大,因为只有到这一步,Agent 才不只是“会完成任务”,而是开始“按你能接受的方式完成任务”。

Soul 层后面会怎么长?我看到三条线:

1. Persona 从文案,变成约束层

今天很多 persona 还停留在“你是一个友好的助手”这种提示词水平。

后面会更工程化,比如:

- 默认沟通风格

- 决策优先级

- 风险偏好

- 对不同用户的互动边界

- 在冲突情况下如何取舍

这已经不只是文风,而是行为一致性问题。

2. Soul 会和 Memory 绑定

Soul 如果只是一段静态 prompt,很快就会空心化。

真正稳定的 persona,要靠长期记忆去喂:

- 你习惯什么表达

- 你讨厌什么格式

- 你在哪些场景下要快,哪些场景下要稳

所以后面 Soul 和 Memory 之间一定是联动的。一个是“我是谁”,一个是“我和你之间发生过什么”。

3. Soul 会变成品牌资产

这点很多公司还没完全意识到。

未来一个成熟 Agent 的竞争力,不只在模型强不强,还在它的人设稳不稳。因为用户最终记住的,往往不是底层权重,而是:

- 这个 Agent 说话是不是靠谱

- 它的风格是不是稳定

- 它是不是总能按同一种价值观做事

这和公司品牌、客服口径、企业文化,道理相通。

第六阶段:有了 Rules,它才不会“有本事,没规矩”

一个能调工具、有记忆、有技能、有长期人格的 Agent,如果没有 Rules,会是什么样?

很可能是一个能力很强、但风险也很高的家伙。

Rules 这一层,说白了就是 Agent 的“超我”和“制度”。

它回答的问题不是“能不能做”,而是:

- 该不该做

- 谁批准了才能做

- 做到什么边界就该停

- 出错以后怎么留痕

这一层后面一定会越来越硬。光在 prompt 里写几句“请注意安全”,那叫自欺欺人。

它会慢慢接近 policy-as-code:

- 可执行

- 可测试

- 可审计

- 可组合

你可以把它理解成,Agent 后面会慢慢从“有能力”进化到“有执照”。

我跟不少人聊过 Agent 未来,发现大家的注意力全在推理能力上。我倒觉得,接下来真正决定 Agent 能不能进生产的,不是它 benchmark 再涨 5 分,而是:

- 有没有权限系统

- 有没有审批流

- 有没有轨迹日志

- 有没有回滚机制

- 有没有针对 prompt injection 的防线

这些东西听起来不性感,但它们决定 Agent 到底是玩具,还是劳动力。

第七阶段:有了 Body,它才真正进入现实世界

前面讲了多模态让 Agent 有了眼睛和耳朵,Tool 给了它手,Memory 是记忆,Soul 是性格,Rules 是规矩。

再往后,Agent 会进一步接入“身体”——不是科幻片里的机器人外壳,而是在环境里的持续存在:

- 桌面代理(常驻在你的电脑里,能操作 GUI)

- 浏览器代理(能自己浏览、填表、点按钮)

- 手机代理(能在移动端帮你处理消息和日程)

- 机器人代理(工厂、仓库、物流场景)

Agent 会从“被你唤醒一次、回答一次”,慢慢变成“常驻在环境里的执行体”。

一旦它有了 Body,很多能力才真正闭环。多模态给了它感知(看和听),Tool 给了它操作能力(调用和执行),Body 把这两者嵌入到一个持续运行的环境里。到了这个阶段,它和今天聊天窗口里的 Agent 就不是一个物种了。

今天很多任务之所以还要人工,不是模型不会想,而是缺可靠的环境接口。等 Body 层补上,很多“看起来需要人”的数字劳动会被迅速改写。

第八阶段:有了 Organization,Agent 才开始像一个团队,而不是一个人

我越来越觉得,Agent 的终局未必是“一个超级 Agent”,而更可能是“一群分工明确的 Agent”。

为什么?因为很多复杂工作,本来就不是一个人完成的。

一个产品上线,往往需要:

- 需求分析

- 技术设计

- 写代码

- 跑测试

- 过安全审查

- 发布

- 监控

- 复盘

你硬把这一切塞给一个 Agent,它不是不能做,而是容易角色打架。既当运动员又当裁判,最后很容易把自己糊弄过去。

所以多 Agent 协作只会更重要。后面会慢慢长出这些东西:

- 角色分工

- 任务委派

- 共享上下文

- 冲突解决

- 汇报链

- 全局调度

这其实已经很像公司的组织架构了。

我感觉自己就象当年干 Production Owner那会儿, 我就负责写需求和验收任务, AI Agents 就象一个 Scrum Team , 把开发, 测试和运维的活都干了。

未来 Agent 不只是像“一个人”,更像“一个小团队”,甚至像“一个数字公司”。

到那一步,最难的问题也会变掉。不再是“模型聪不聪明”,而是:

- 谁对最终结果负责

- 多个 Agent 的记忆怎么共享

- 冲突决策由谁裁定

- 成本和预算怎么控制

- 哪一步必须人类签字

这才是真正的系统工程。

那它到底会替代人,还是解放人?

这个问题大家的看法不一, 大致方向我觉得会在解放生产力的同时, 让一部分人失业。

我的基本判断是:先替代一部分工作环节,再解放一部分人,最后重排整个人机分工。

它不是一道判断题,而是一个时间顺序题。

先被替代的,是什么?

通常是这些特征明显的工作:

- 流程清晰

- 规则稳定

- 输入输出结构化

- 容错空间小但边界清楚

- 可以被拆成明确步骤

比如:

- 一级客服

- 资料收集

- 报告初稿

- 代码脚手架

- 常规测试

- 表单流转

- 日程协调

这些活,本来就很像 SOP 的流水线。Agent 有了 Tool、Skill、Memory、Rules 之后,天然适合吃这一类。

不容易被替代的,是什么?

不是“高级工作”这四个字,而是这些特征:

- 目标本身含糊

- 利益冲突复杂

- 责任边界模糊

- 需要承担后果

- 需要人类信誉背书

比如:

- 关键业务拍板

- 高风险法律责任

- 组织政治平衡

- 创业方向选择

- 对外关系和信任建立

这些事情里,真正稀缺的不是信息处理,而是责任、信誉和承担后果的能力。

模型可以替你想,Agent 可以替你跑,但“出事了谁负责”这件事,短时间内还得是人。

那“解放人”体现在哪儿?

我觉得后面最大的变化,不是每个人都失业,而是每个人都开始带 Agent 上班。

就像当年不是 Excel 消灭了财务,而是不会用 Excel 的财务先难受;不是 IDE 消灭了程序员,而是不会用 IDE 的程序员先落后。

Agent 更可能先把知识工作拆成两部分:

- 可流程化的劳动:交给 Agent

- 高责任、高模糊度的判断:留给人

于是人的角色会慢慢变成:

- 定目标的人

- 设规则的人

- 审结果的人

- 处理例外的人

- 为最终后果负责的人

换句话说,人不会马上退出回路,但会慢慢退出那些重复、低杠杆、机械性的脑力劳动。

接下来两三年,我更看好的几个技术方向

往后看,我觉得 Agent 最值得盯的不是“单次回答质量”,而是下面这几件事:

1. Context Engineering 会成为显学

未来比拼的重点,不只是模型大小,而是:

- 什么该放进上下文

- 什么该检索

- 什么该记住

- 什么该忘掉

不会管理上下文的 Agent,就像不会管理桌面的员工,东西再多也干不好活。

2. Evals 会从“测答案”变成“测轨迹”

以后评估 Agent,不能只看最终回答。还要看:

- 工具选得对不对

- 顺序合不合理

- 有没有多余动作

- 有没有违反规则

- 成本和时间是否可接受

eval 的对象不再是答案,而是整条 trajectory。

3. Governance 会成为标配,不是可选项

有些团队现在还觉得权限、审计、审批这些东西太重了,先把效果做出来再说。

可一旦 Agent 真开始接入生产系统、客户数据、代码仓库、付款链路,这些东西一个都省不了。

后面真正能落地的 Agent,不会是最会说话的那个,而是最守规矩的那个。

4. Multi-Agent 会从炫技,变成必要架构

单 Agent 能干很多事,但复杂任务迟早要分工。

未来比较靠谱的架构,很可能是:

- 一个 planner

- 几个 specialist

- 一个 reviewer

- 一个 policy gatekeeper

这比让一个 Agent 一口气包打天下,更稳。

5. 多模态会从“加分项”变成“基本功”

今天很多 Agent 还停留在纯文本交互。但实际工作场景里,截图、语音、视频、PDF 才是信息的主要载体。

后面的竞争力,不在于“能不能看图”,而在于:

- 多模态理解的准确率(看架构图能不能看对)

- 跨模态推理(听完会议 + 看完文档 = 给出综合建议)

- 多模态记忆(不只记文字,还记图、记声音)

- 端到端的多模态工作流(从截图到修复到验证,全链路不掉链子)

一个只会读文字的 Agent,就像一个只会看邮件的同事——能干活,但效率和你带着眼睛耳朵干活的人比,差很多。

总结

如果只用一句话概括我的判断,那就是:

AI Agent 的未来,不是突然“变成人”,而是一步一步补齐人类工作的功能器官。

先有脑子,再有眼睛和耳朵,再有手;然后是套路、记忆、人格、规矩;再往后有身体,有团队,有组织能力。你今天看到的多模态、Tool、Skill、Memory、Soul、Rules,并不是零散功能,而是同一条演化链上的不同节点。

所以它会替代人吗?会,先替代一部分环节。它会解放人吗?也会,前提是咱们别固执地把自己绑在那些最容易被流程化的活儿上。

真正值得关心的,不是“Agent 会不会像人”,而是:

当 Agent 越来越像一个能上班的数字同事时,人准备好做那个设目标、立规矩、扛责任的人了吗?

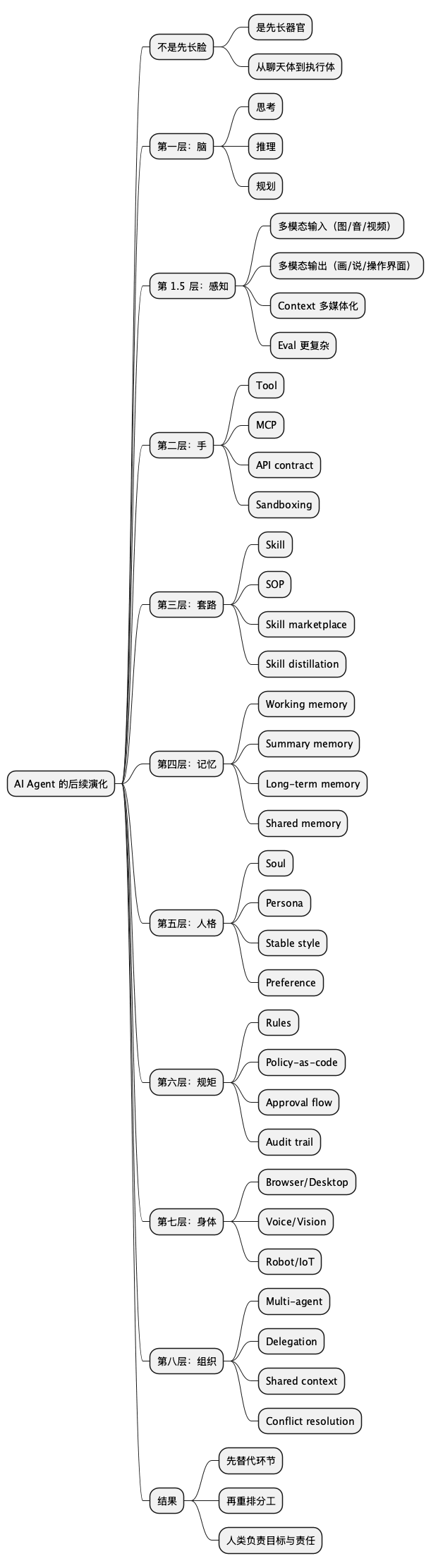

@startmindmap

* AI Agent 的后续演化

** 不是先长脸

*** 是先长器官

*** 从聊天体到执行体

** 第一层:脑

*** 思考

*** 推理

*** 规划

** 第 1.5 层:感知

*** 多模态输入(图/音/视频)

*** 多模态输出(画/说/操作界面)

*** Context 多媒体化

*** Eval 更复杂

** 第二层:手

*** Tool

*** MCP

*** API contract

*** Sandboxing

** 第三层:套路

*** Skill

*** SOP

*** Skill marketplace

*** Skill distillation

** 第四层:记忆

*** Working memory

*** Summary memory

*** Long-term memory

*** Shared memory

** 第五层:人格

*** Soul

*** Persona

*** Stable style

*** Preference

** 第六层:规矩

*** Rules

*** Policy-as-code

*** Approval flow

*** Audit trail

** 第七层:身体

*** Browser/Desktop

*** Voice/Vision

*** Robot/IoT

** 第八层:组织

*** Multi-agent

*** Delegation

*** Shared context

*** Conflict resolution

** 结果

*** 先替代环节

*** 再重排分工

*** 人类负责目标与责任

@endmindmap

明天就能做的 5 件事

- 盘点一下你现在的工作里,哪些已经可以被拆成清晰 SOP,这些最容易先被 Agent 吃掉。

- 给你的 Agent 补上长期记忆和技能文件,不要只把它当聊天机器人。

- 让 Agent 接一个真实工具,而不只是让它“给建议”。

- 对高风险动作加一层审批或 review,不要让 Agent 裸奔进生产环境。

- 试着把自己的一项核心工作拆成“Agent 可做”和“必须我负责”两部分。

一个开放式问题

如果未来 Agent 真的把工具、技能、记忆、人格、规则、身体、组织能力都补齐了,那人类在工作里最后剩下的“不可替代性”,究竟是创造力、责任心,还是仅仅因为法律今天还要求必须有人签字?

参考链接

- Introducing the Model Context Protocol

- Equipping agents for the real world with Agent Skills

- State of AI Agent Memory 2026

- AI Agents in 2026: Practical Architecture for Tools, Memory, Evals, and Guardrails

- AI Agent Memory Architectures for Multi-Agent Systems

- AI Agent 为什么会越用越懂你?从 OpenClaw 的“养龙虾”聊起

本作品采用知识共享署名-非商业性使用-禁止演绎 4.0 国际许可协议进行许可。